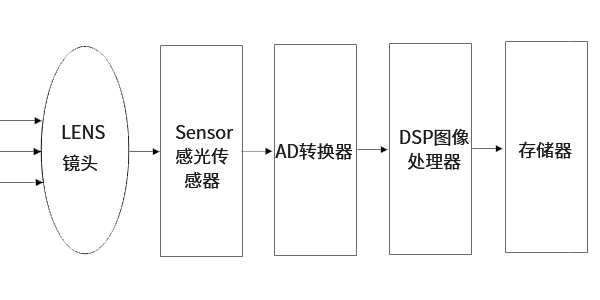

Grundstruktur des Kameramoduls

I. Kameraaufbau und Funktionsprinzip

Die Szene wird durch das Objektiv aufgenommen, das erzeugte optische Bild wird auf den Sensor projiziert und dann wird das optische Bild in ein elektrisches Signal umgewandelt, das durch Analog-Digital-Wandlung in ein digitales Signal umgewandelt wird.Das digitale Signal wird vom DSP verarbeitet und dann zur Verarbeitung an den Computer gesendet und schließlich in ein Bild umgewandelt, das auf dem Telefonbildschirm angezeigt werden kann.

Funktion des digitalen Signalverarbeitungschips (DSP): Optimieren Sie die digitalen Bildsignalparameter durch eine Reihe komplexer mathematischer Algorithmen und übertragen Sie die verarbeiteten Signale über USB und andere Schnittstellen an PCs und andere Geräte.DSP-Strukturrahmen:

1、 ISP (Bildsignalprozessor)

1. ISP (Bildsignalprozessor)

2. JPEG-Encoder

2. JPEG-Encoder

3、 USB-Gerätecontroller

3. USB-Gerätecontroller

Es gibt zwei Arten von gängigen Kamerasensoren,

Einer ist der CCD-Sensor (Chagre Couled Device), dh ein ladungsgekoppeltes Gerät.

Der andere ist ein CMOS-Sensor (Complementary Metal-Oxide Semiconductor), dh ein komplementärer Metalloxid-Halbleiter.

Der Vorteil von CCD liegt in der guten Abbildungsqualität, aber der Herstellungsprozess ist kompliziert, die Kosten sind hoch und der Stromverbrauch ist hoch.Bei gleicher Auflösung ist CMOS billiger als CCD, aber die Bildqualität ist geringer als bei CCD.Im Vergleich zu CCD hat der CMOS-Bildsensor einen geringeren Stromverbrauch.Darüber hinaus wurde mit dem Fortschritt der Prozesstechnologie auch die Bildqualität von CMOS kontinuierlich verbessert.Daher verwenden die aktuellen Handykameras auf dem Markt alle CMOS-Sensoren.

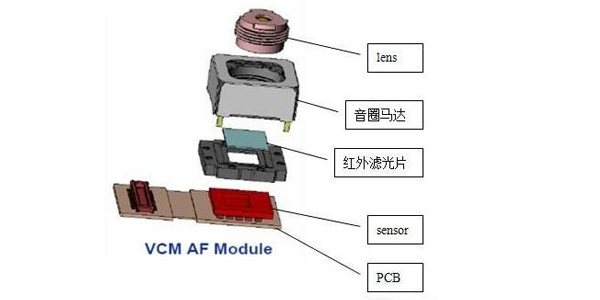

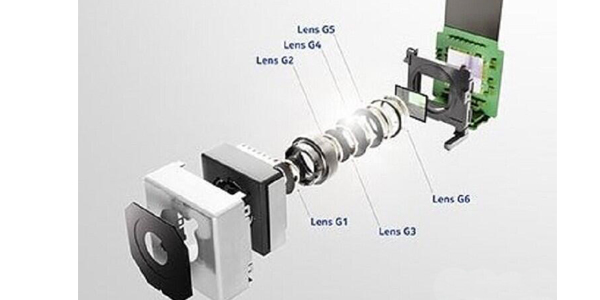

Einfache Struktur der Handykamera

Linse: sammelt Licht und projiziert die Szene auf die Oberfläche des Abbildungsmediums.

Bildsensor: das Abbildungsmedium, das das vom Objektiv auf die Oberfläche projizierte Bild (Lichtsignal) in ein elektrisches Signal umwandelt.

Motor: treibt die Bewegung des Objektivs an, sodass das Objektiv ein klares Bild auf die Oberfläche des Abbildungsmediums projiziert.

Farbfilter: Die vom menschlichen Auge gesehene Szene befindet sich im sichtbaren Lichtband, und der Bildsensor kann das Lichtband besser erkennen als das menschliche Auge.Daher wird ein Farbfilter hinzugefügt, um das überschüssige Lichtband herauszufiltern, sodass der Bildsensor tatsächliche Szenen erfassen kann, die von Augen gesehen werden.

Motorantriebschip: Wird verwendet, um die Bewegung des Motors zu steuern und das Objektiv anzutreiben, um Autofokus zu erreichen.

Leiterplattensubstrat: Übertragen Sie das elektrische Signal des Bildsensors an das Backend.

II.Verwandte Parameter und Substantive

1. Gängige Bildformate

1.1 RGB-Format:

Das traditionelle Rot-, Grün- und Blauformat wie RGB565 und RGB888;Das 16-Bit-Datenformat ist 5-Bit-R + 6-Bit-G + 5-Bit-B. G hat ein Bit mehr, weil das menschliche Auge empfindlicher für Grün ist.

1.2 YUV-Format:

Luma (Y) + Chroma (UV)-Format.YUV bezieht sich auf das Pixelformat, in dem der Luminanzparameter und der Chrominanzparameter separat ausgedrückt werden.Der Vorteil dieser Trennung ist, dass sie nicht nur gegenseitige Beeinflussung vermeidet, sondern auch die Chroma-Abtastrate reduziert, ohne die Bildqualität zu sehr zu beeinträchtigen.YUV ist ein allgemeinerer Begriff.Für seine spezifische Anordnung kann es in viele spezifische Formate unterteilt werden.

Chroma (UV) definiert zwei Aspekte der Farbe: Farbton und Sättigung, die jeweils durch CB und CR dargestellt werden.Darunter spiegelt Cr die Differenz zwischen dem roten Teil des RGB-Eingangssignals und dem Helligkeitswert des RGB-Signals wider, während Cb die Differenz zwischen dem blauen Teil des RGB-Eingangssignals und dem Helligkeitswert des RGB-Signals widerspiegelt.

Die wichtigsten Abtastformate sind YCbCr 4:2:0, YCbCr 4:2:2, YCbCr 4:1:1 und YCbCr 4:4:4.

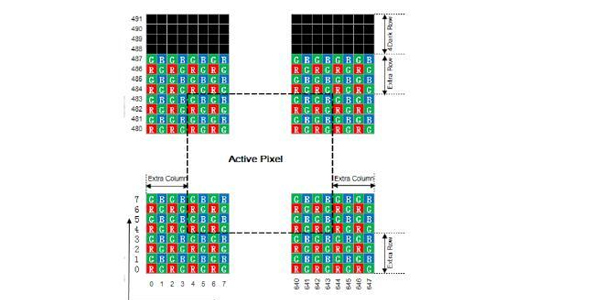

1.3 RAW-Datenformat:

Das RAW-Bild sind die Rohdaten, mit denen der CMOS- oder CCD-Bildsensor das erfasste Lichtquellensignal in ein digitales Signal umwandelt.Eine RAW-Datei ist eine Datei, die die Originalinformationen des Digitalkamerasensors und einige von der Kamera generierte Metadaten (wie ISO-Einstellungen, Verschlusszeit, Blendenwert, Weißabgleich usw.) aufzeichnet.RAW ist ein unverarbeitetes und unkomprimiertes Format und kann als „rohbildcodierte Daten“ oder anschaulicher als „digitales Negativ“ bezeichnet werden.Jedes Pixel des Sensors entspricht einem Farbfilter, und die Filter sind gemäß dem Bayer-Muster verteilt.Die Daten jedes Pixels werden direkt ausgegeben, nämlich RAW-RGB-Daten

Rohdaten (Roh-RGB) werden nach der Farbinterpolation zu RGB.

Bildbeispiel im RAW-Format

2. Verwandte technische Indikatoren

2.1 Bildauflösung:

SXGA (1280 x 1024), 1,3 Megapixel

XGA (1024 x 768), 0,8 Megapixel

SVGA (800 x 600), 0,5 Megapixel

VGA (640 x 480), 0,3 Megapixel (0,35 Megapixel beziehen sich auf 648 x 488)

CIF (352 x 288), 0,1 Megapixel

SIF/QVGA (320 x 240)

QCIF (176 x 144)

QSIF/QQVGA (160 x 120)

2.2 Farbtiefe (Anzahl der Farbbits):

Graustufen mit 256 Farben, 256 Arten von Grau (einschließlich Schwarz und Weiß).

15- oder 16-Bit-Farbe (High Color): 65.536 Farben.

24-Bit-Farbe (True Color): Jede Primärfarbe hat 256 Stufen und ihre Kombination hat 256*256*256 Farben.

32-Bit-Farbe: Zusätzlich zur 24-Bit-Farbe werden die zusätzlichen 8 Bit verwendet, um die Grafikdaten der überlappenden Ebene (Alpha-Kanal) zu speichern.

2.3 Optischer Zoom und digitaler Zoom:

Optischer Zoom: Vergrößern/verkleinern Sie das Objekt, das Sie aufnehmen möchten, indem Sie das Objektiv anpassen.Die Pixel und die Bildqualität bleiben im Wesentlichen unverändert, aber Sie können ein ideales Bild aufnehmen.Digitalzoom: Es gibt eigentlich keinen Zoom.Es nimmt einfach das Originalbild auf und zoomt hinein. Was Sie auf dem LCD-Bildschirm sehen, wird vergrößert, aber die Bildqualität wird nicht wesentlich verbessert, und die Pixel sind niedriger als die maximale Pixelzahl, die Ihre Kamera aufnehmen kann.Die Bildqualität ist im Grunde unwürdig, kann aber für etwas Komfort sorgen.

2.4 Bildkomprimierungsmethode:

JPEG/M-JPEG

H.261/H.263

Mpeg

H.264

2.5 Bildrauschen:

Es bezieht sich auf das Rauschen und die Interferenz im Bild und erscheint als festes Farbrauschen im Bild.

2.6 Automatischer Weißabgleich:

Einfach gesagt: die Restaurierung weißer Objekte durch die Kamera.Verwandte Konzepte: Farbtemperatur.

2.7 Betrachtungswinkel:

Es hat das gleiche Prinzip wie die Abbildung des menschlichen Auges, die auch als Abbildungsbereich bezeichnet wird.

2.8 Autofokus:

Der Autofokus kann in zwei Kategorien unterteilt werden: Die eine ist der Bereichs-Autofokus basierend auf der Entfernung zwischen Objektiv und dem Motiv, und die andere ist der Fokuserkennungs-Autofokus basierend auf einer klaren Abbildung auf der Mattscheibe (Schärfe-Algorithmus).

Hinweis: Durch Zoomen sollen entfernte Objekte näher gebracht werden.Der Fokus soll das Bild klar machen.

2.9 Automatische Belichtung und Gamma:

Es ist die Kombination aus Blende und Verschluss.Blende, Verschlusszeit, ISO.Gamma ist die Reaktionskurve des menschlichen Auges auf Helligkeit.

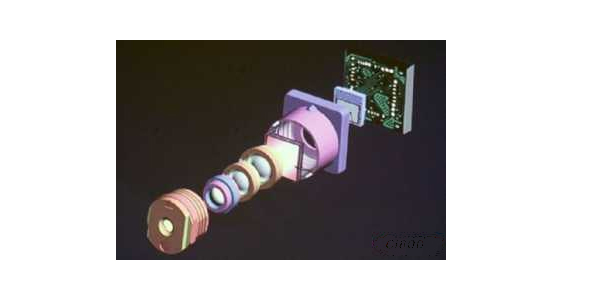

III.Andere Kamerastruktur

3.1 Kamerastruktur mit festem Fokus

3.2 Aufbau der optischen Bildstabilisierungskamera

3.3 MEMS-Kamera

Postzeit: 28. Mai 2021